¿QUE ES ETHERNET?

La ethernet es una capa de hardware o nivel físico para las redes, como todo el mundo sabe no es la única disponible, aunque si la más utilizada y extendida. Ethernet es el protocolo por el cual se comunican los computadores en un entorno LOCAL de red. El cable que se inserta atrás de la computadora y parece un "jack" de teléfono grande es utilizado para enviar información en este protocolo, la computadora utiliza una tarjeta NIC ("Network Interface Card") para realizar la comunicación.

Es un estándar de redes de computadoras para conectar dos o más computadoras locales, en una proximidad física con el que se podrá intercambiar información entre computadoras y manejar completamente una computadora desde la otra. Además de poder compartir el acceso a internet.

Ethernet es una popular tecnología LAN (Red de Área Local) que como protocolo es considerado el Acceso múltiple con portadora y detección de colisiones (Carrier Sense Múltiple Access with Collision Detection, CSMA/CD) entre estaciones con diversos tipos de cables, lo cual significa que por su cable solo puede ser transmitida una sola señal a cierto punto en el tiempo, esto es, si a un cable se encuentran conectadas 10 o 20 PC's, sólo una puede transmitir información a la vez,las demás deben esperar a que finalice la transmisión.

Además de esta característica CSMA/CD, el protocolo "Ethernet" también utiliza lo que es denominado "Broadcast" o "Transmisión a todas las terminales" , considerando el ejemplo anterior, lo que ocurre cuando una PC envía información es que las otras 9 o 19 recibirán esta misma información, lo que sucede posteriormente es que solo la PC con la dirección MAC especificada acepta la información, las restantes la descartan.

Ethernet define las características de cableado y señalización de nivel físico y los formatos de tramas de datos del nivel de enlace de datos del modelo OSI. La Ethernet se tomo como base para la redacción del estándar internacional IEEE 802.3. Usualmente se toman Ethernet e IEEE 802.3 como sinónimos. Ambas se diferencian en uno de los campos de la trama de datos. Las tramas Ethernet e IEEE 802.3 pueden coexistir en la misma red.

Desde sus inicios, la red Ethernet ha venido evolucionando para dotarse de más capacidad, seguridad, fiabilidad, calidad de servicio, protección, facilidades de operación y mantenimiento, etc. Esta evolución la ha hecho dejando prácticamente inalteradas las especificaciones no físicas, de manera que sea compatible con los estándares anteriores, lo que ha sido parte de su gran éxito, ya que de esta manera la mayor parte del equipamiento y, consecuentemente, la inversión realizada, seguía siendo válida.

COMPONENTES DE ETHERNET:

Consta de cuatro elementos básicos:

El medio físico: compuesto por los cables y otros elementos de hardware, como conectores, utilizados para transportar la señal entre los computadores conectados a la red.

Los componentes de señalización: dispositivos electrónicos estandarizados (transceivers) que envían y reciben señales sobre un canal Ethernet.

El conjunto de reglas para acceder al medio: protocolo utilizado por la interfaz (tarjeta de red) que controla el acceso al medio y que le permite a los computadores acceder (utilizar) de forma compartida el canal Ethernet. Existen dos modos: half y full dúplex.

El frame (paquete) Ethernet: conjunto de bits organizados de forma estándar. El frame es utilizado para llevar los datos dentro del sistema Ethernet. También recibe el nombre de marco o trama.

CARACTERISTICAS DE ETHERNET:

-Utiliza un medio de transmisión PASIVO, es decir, no requiere una fuente de alimentación propia su fuente de alimentación son los mismos equipos, y por tanto,

-NO FALLA, si falla un equipo la comunicación no se pierde a menos que el cable se corte físicamente o su terminación sea incorrecta.

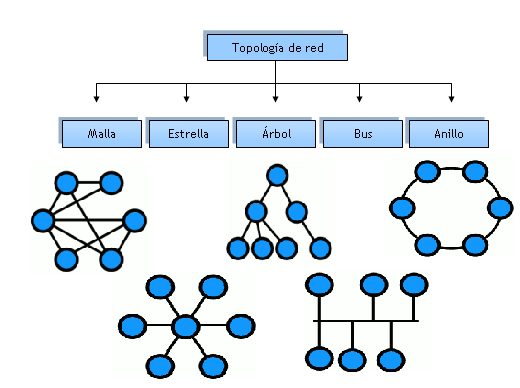

-Se conecta utilizando una TOPOLOGÍA DE BUS en la que el cable está terminado en ambos extremos.

-UTILIZA MÚLTIPLES PROTOCOLOS DE COMUNICACIÓN y puede conectar entornos informáticos heterogéneos, incluyendo Netware, UNIX, Windows y Macintosh.

OBJETIVOS DE ETHERNET:

La idea original de Ethernet nació del problema de permitir que dos o mas hots utilizaran el mismo medio y evitar que las señales interfirieran entre si. Los objetivos principales de Ethernet son consistentes con los que se han convertido en los requerimientos básicos para el desarrollo y uso de redes LAN.

Los objetivos originales de Ethernet son:

Simplicidad

Las características que puedan complicar el diseño de la red sin hacer una contribución substancial para alcanzar otros objetivos se han excluido.

Bajo Costo

Las mejoras tecnológicas van a continuar reduciendo el costo global de los dispositivos de conexión.

Compatibilidad

Todas las implementaciones de Ethernet deberán ser capaces de intercambiar datos a nivel de capa de enlace de datos. Para eliminar la posibilidad de variaciones incompatibles de Ethernet, la especificación evita características opcionales.

Direccionamiento flexible

El mecanismo de direccionamiento debe proveer la capacidad de dirigir datos a un único dispositivo, a un grupo de dispositivos, o alternativamente, difundir (broadcast) el mensaje a todos los dispositivos conectados a la red.

Equidad

Todos los dispositivos conectados deben tener el mismo acceso a la red.

Progreso

Ningún dispositivo conectado a la red, operando de acuerdo al protocolo Etheret, debe ser capaz de prevenir la operación de otros dispositivos.

Alta velocidad

La red debe operar eficientemente a una tasa de datos de 10 Mb/s.

Bajo retardo

En cualquier nivel de tráfico de la red, debe presentarse el mínimo tiempo de retardo posible en la transferencia de datos.

Estabilidad

La red debe ser estable bajo todas las condiciones de carga. Los mensajes entregados deben mantener un porcentaje constante de la totalidad del tráfico de la red.

Mantenimiento

El diseño de Ethernet debe simplificar el mantenimiento de la red, operaciones y planeamiento.

Arquitectura en capas

El diseño Ethernet debe ser especificado en término de capas de forma de separar las operaciones lógicas de los protocolos de capa de enlace de las especificaciones de comunicaciones físicas del canal de comunicación.

EVOLUCION

• ETHERNET ESTANDAR

Utilizaba hub (Medio compartido) – Halfduplex.

Opera en capa 1 de modelo OSI.

Redes 10BASE-T.

• ETHERNET ACTUAL

Uso de switches para remplazar los hubs.

Redes 100BASE-TX.

Controlan el flujo de datos aislando cada puerto.

Comunicaciones full dúplex.

Opera en capa 2 de modelo OSI.

• ETHERNET GIGABIT

Redes más sólidas.

Más servicios que requieren conexiones más rápidas.

Creados sobre medios UTP y fibra óptica.

Ethernet Gigabit se aplica más allá de la LAN (A través de fibra óptica).

VENTAJAS DE ETHERNET:

Ethernet es popular porque permite un buen equilibrio entre velocidad, costo y facilidad de instalación. Estos puntos fuertes, combinados con la amplia aceptación en el mercado y la habilidad de soportar virtualmente todos los protocolos de red populares, hacen a Ethernet la tecnología ideal para la red de la mayoría de usuarios de la informática actual.

Sencillez y facilidad de mantenimiento. Capacidad para incorporar nuevas tecnologías.

Confiabilidad, Bajo costo de instalación y de actualización. Con la llegada de Gigabit

Ethernet, lo que comenzó como una tecnología LAN ahora se extiende a distancias que hacen de Ethernet un estándar de red de área metropolitana (MAN) y red de área amplia (WAN).

HISTORIA

PRECURSORES

Norman Abramson fue el desarrollador de ALOHAnet. El y sus colaboradores pretendían conectar usuarios remotos con una computadora central situada en Honolulu. Realizo la primera red que transmitió datos en una computadora por medio de ondas de radio en vez de cables y líneas telefónicas.

Fueron las primeras experiencias de redes broadcast (Son las redes donde lo datos llegan a todas las maquinas de la red, un solo canal de comunicación) en Hawaii: ALOHANET. Protocolos MAC ALOHA puro (En este protocolo las estaciones transmiten en cuanto tienen datos para enviar, al actuar así se producen colisiones, estas colisiones deberán de ser descartadas para proseguir con la transmisión) y ranurado (Es un método en el que el tiempo se divide en intervalos discretos (ranuras), de esta forma las estaciones sólo pueden transmitir cuando comienza un intervalo, solo se producirán colisiones porque dos o más máquinas transmitan con el mismo intervalo), es decir sin detección de portadora.

Mientras Abramson montaba ALOHANET en Hawaii, un estudiante del MIT llamado Robert Metcalfe experimentaba con la recién estrenada ARPANET y conectaba ordenadores en un laboratorio. Metcalfe conocía las experiencias de Abramson y empezó una tesis doctoral en Harvard (que terminaría en 1973), en la que desde un punto de vista teórico planteaba mejoras que se podrían introducir al protocolo ALOHA para aumentar su rendimiento. La idea básica era muy simple: las estaciones antes de transmitir deberían detectar si el canal ya estaba en uso (es decir si ya había 'portadora'), en cuyo caso esperarían a que la estación activa terminara antes de transmitir. Además,cada estación mientras transmitiera estaría continuamente vigilando el medio físico por si se producía alguna colisión, en cuyo caso pararía y transmitiría más tarde. Años después este protocolo MAC recibiría la denominación Acceso Múltiple con Detección de Portadora y Detección de Colisiones, o mas brevemente CSMA/CD (Carrier Sense Multiple Access / Colision Detect).

En 1972 Metcalfe se mudó a California para trabajar en el Centro de Investigación de Xerox en Palo Alto llamado Xerox PARC (Palo Alto Research Center). Se estaban probando unos ordenadores denominados Alto, que disponían de capacidades gráficas y ratón y son considerados los primeros ordenadores personales. También se estaban fabricando las primeras impresoras láser. Se quería conectar los ordenadores entre sí para compartir ficheros y las impresoras. La comunicación tenía que ser de muy alta velocidad, del orden de megabits por segundo, ya que la cantidad de información a enviar a las impresoras era enorme (tenían una resolución y velocidad comparables a una impresora láser actual).

A Metcalfe, el especialista en comunicaciones del equipo con 27 años de edad, se le encomendó la tarea de diseñar y construir la red que uniera todo aquello. Contaba para ello con la ayuda de un estudiante de doctorado de Stanford llamado David Boggs. Las primeras experiencias de la red, que denominaron ‘Alto Aloha Network’, las llevaron a cabo en 1972. Fueron mejorando gradualmente el prototipo.

NACIMIENTO

22 de mayo de 1973 Metcalfe escribió un memorándum interno en el que informaba de la nueva red. Para evitar que se pudiera pensar que sólo servía para conectar ordenadores Alto cambió el nombre inicial por el de Ethernet, que hacía referencia a la teoría de la física hoy ya abandonada según la cual las ondas electromagnéticas viajaban por un fluido denominado éter que se suponía llenaba todo el espacio (para Metcalfe el 'éter' era el cable coaxial por el que iba la portadora).

La red de 1973 ya tenía todas las características esenciales de la Ethernet actual. Empleaba CSMA/CD para minimizar la probabilidad de colisión, y en caso de que ésta se produjera ponía en marcha el mecanismo de retroceso exponencial binario para reducir gradualmente la ‘agresividad’ del emisor, con lo que éste se adaptaba a situaciones de muy diverso nivel de tráfico. Tenía topología de bus y funcionaba a 2,94 Mb/s sobre un segmento de cable coaxial de 1,6Km de longitud. Las direcciones eran de 8 bits y el CRC de las tramas de 16 bits. El protocolo utilizado al nivel de red era el PUP (Parc Universal Packet) que luego evolucionaría hasta convertirse en el actual XNS (Xerox Network System). En vez de utilizar cable coaxial de 75 W, más habitual por ser el utilizado en redes de televisión por cable, se optó por emplear cable de 50 W que producía menos reflexiones de la señal, a las cuales Ethernet era muy sensible por transmitir la señal en banda base (es decir sin modulación). Las reflexiones se producen en cada empalme del cable y en cada 'pincho' vampiro (transceiver). En la práctica el número máximo de pinchos vampiro, y por tanto el número máximo de estaciones en un segmento de cable coaxial, viene limitado por la máxima intensidad de señal reflejada tolerable.

En 1975 Metcalfe y Boggs describieron Ethernet en un artículo que enviaron para su publicación a Communications of the ACM (Association for Computing Machinery).

Xerox creó una nueva división denominada SDD (Systems Development Division) para el desarrollo de los ordenadores personales y de la red Ethernet (ambos proyectos estaban íntimamente relacionados). Metcalfe, Boggs y varios ingenieros más fueron asignados para trabajar en la mejora de la red. Se introdujeron algunos cambios en la tecnología, y por razones de marketing se decidió cambiar el nombre de la red de Ethernet a X-wire.

Por aquellos años la tendencia de la mayoría de los fabricantes era hacia arquitecturas de redes jerárquicas. El planteamiento de Xerox era radicalmente opuesto y novedoso. Cada usuario disponía de un ordenador conectado directamente a la red local, integrando en él todas las funciones. No existía ningún control centralizado de la red. La comunicación entre dos usuarios cualesquiera ocurría directamente, sin intermediarios y en condiciones de igual a igual ('peer to peer'). Ligada a esta arquitectura distribuida estaba la necesidad de una red de muy alta velocidad para los estándares de la época (baste recordar que por aquel entonces los módems mas veloces eran de 1200 b/s, y en el año 1976 Intel anunció el procesador 8080 que funcionaba a 4,77 MHz).

Xerox no supo o no pudo aprovechar comercialmente este acierto. En el caso de Ethernet jugaba en su contra el hecho de ser una tecnología propietaria y no ser Xerox una empresa lo suficientemente grande como para imponer sus productos frente a sus competidores, aspecto fundamental tratándose de comunicaciones. Seguramente también influyó el hecho de ser una tecnología demasiado avanzada para su época. Metcalfe comprendió perfectamente que Ethernet solo podría avanzar si se desarrollaba como un estándar abierto y en cooperación con otros fabricantes, ya que así obtendría un mayor impulso comercial y tecnológico.

Fue publicado el artículo que enviaron a Communications of the ACM (Association for Computing Machinery). En él ya describían el uso de repetidores para aumentar el alcance de la red.

Robert Metcalfe presentó Ethernet en una conferencia durante la que dibujó lo que queda como el primer dibujo conocido de Ethernet:

En realidad este dibujo se puede representar asi:

EVOLUCION

Metcalfe, Boggs y otros dos ingenieros de Xerox recibieron una patente por la tecnología básica de Ethernet.

Metcalfe y Boggs recibieron patente por el repetidor. En esta época todo el sistema Ethernet era propietario de Xerox.

Para un mayor impulso comercial y tecnológico, se crea alianza DIX (DEC “Digital Equipment Corporation”-Intel-Xerox) fue satisfactoria en todos los aspectos, excepto en el nombre X-wire, por lo que Xerox volvió al nombre inicial Ethernet aceptado por todos. También se pretendia subir la velocidad de la red a 10 Mb/s. A la Ethernet original de 2,94 Mb/s se la conoce como Ethernet Experimental para distinguirla de la de 10 Mb/s que fue el primer producto comercial.

En junio de 1979 Metcalfe abanda Xerox para crear su propia empresa especializada en Computadores, Comunicaciones y Compatibilidad, mas conocida como 3Com.

En febrero de 1980 el comité de redes locales IEEE pone en marcha un proyecto sobre la tecnología para establecer el estándar de red local de 1 a 2 Mbps con el objetivo de que los productos de diferentes fabricantes puedan interoperar, habría libre competencia y los precios bajarían, beneficiando al usuario.

El proyecto se denominó 802 (año y mes de su constitución). Inicialmente el proyecto (o comité) propuso que el proceso de estandarización: debía ser abierto, ordenado y justo. Decidieron estandarizar el nivel físico, el de enlace y superiores. Dividieron el nivel de enlace en dos subniveles: el de enlace lógico, encargado de la lógica de re-envíos, control de flujo y comprobación de errores, y el subnivel de acceso al medio, encargado de arbitrar los conflictos de acceso simultaneo a la red por parte de las estaciones.

Pero en abril de 1980, la alianza DIX informó al comité 802 que estaba terminando el diseño y especificación de una tecnología de red local, que la propondría para su estandarización, pero que el comité no podría participar en su elaboración.

El comité 802 recibió otra de General Motors de una red denominada Token Bus, también con topología de bus pero que utilizaba un protocolo MAC basado en paso de testigo e IBM presentó otra de una red con topología de anillo y paso de testigo que recibía el nombre de Token Ring.

Como no sería posible satisfacer a todos con un único estándar, y considerando el apoyo de la industria a las tres propuestas no podía descartar ninguna, optó por aceptar las tres propuestas y crear un subcomité para cada una de ellas: 802.3 para CSMA/CD (Ethernet), 802.4 para Token Bus y 802.5 para Token Ring. Cada uno de estos tres "estándares" tenía un nivel físico diferente, un subnivel de acceso al medio distinto pero con algún rasgo común (espacio de direcciones y comprobación de errores), y un nivel de enlace lógico único para todos ellos.

El comité 802.3 introdujo cambios, el más importante fue la sustitución del campo tipo (que especifica el protocolo del nivel de red) por un campo longitud, inexistente hasta entonces. Esta pequeña modificación tenía el efecto colateral de hacer incompatible el estándar IEEE 802.3 con Ethernet DIX, Xerox resolvió en parte el problema de incompatibilidad producido por la decisión del IEEE asignando a todos los protocolos códigos superiores a 1536, valor máximo del campo longitud. Así analizando el valor de este campo podemos saber si la trama tiene formato DIX u 802.3. Los dos formatos son incompatibles, pero pueden coexistir en una misma red.

En septiembre de 1980 DIX publicó las especificaciones de Ethernet Versión 1.0 conocidas como 'libro azul' a velocidad de 10 Mbps. Como parte de la política aperturista Xerox aceptó licenciar su tecnología patentada a todo el que lo quisiera por una cuota. Mas tarde con la aprobación de los estándares 802 la gestión de esas direcciones pasó a desempeñarla el IEEE, que sigue cobrando actualmente en concepto de tareas administrativas. La publicación del libro azul hizo de Ethernet la primera tecnología de red local abierta multivendedor, ya que a partir de ese momento cualquier fabricante podía construir equipamiento conforme con la norma Ethernet.

3Com fabrica primeras tarjetas Ethernet para PC.

En 1982 se publicó Ethernet Versión 2.0, que fue la última especificación de Ethernet publicada por DIX, velocidad de 10Mbps. En estas especificaciones el único medio físico que se contemplaba era el cable coaxial grueso hoy conocido como 10BASE5. En ese mismo año 1982 Xerox liberó la marca registrada que ostentaba sobre el nombre Ethernet.

3Com produce las primeras tarjetas 10BASE2 para PC.

Los componentes de las primeras redes Ethernet (repetidores, transceivers, tarjetas de red, etc.) eran muy caros.

Aparecieron a partir de 1982 productos en el mercado que permitían utilizar Ethernet sobre cable coaxial RG58, también de 50 ohmios pero mas fino y barato. Utilizaba conectores BNC en vez de conectores tipo N, y no requería cable drop ya que el equipo se podía enchufar directamente al cable bus mediante un conector en T, estando en este caso la función del transceiver integrada en la tarjeta de red. En conjunto se conseguía un ahorro importante respecto al cable grueso tradicional, razón por la cual este cable se conocía con el nombre de cheapernet ('red más barata'). Este cable tenía un menor apantallamiento que el 10BASE5, lo cual le confería una mayor atenuación y por ende menor alcance (185 m por segmento en vez de 500 m). La interconexión de segmentos cheapernet (o thinwire como también se le llamaba) con segmentos de coaxial grueso (o thickwire) se podía realizar mediante repetidores. El cable coaxial fino fue incorporado al estándar 802.3 con la denominación 10BASE2 mediante una adenda que el IEEE aprobó en 1985.

El 24 de junio de 1983 el IEEE aprobó el estándar 802.3, contemplando como medio físico únicamente el cable coaxial grueso, al cual denominó 10BASE5. En el estándar se recomienda que el cable sea de color amarillo para que no se confunda en las conducciones con los cables de alimentación eléctrica. El estándar IEEE 802.3 fue propuesto a continuación a ANSI, después fue propuesto para su aprobación por el ISO.

El estándar IEEE 802.3 fue aprobado por ANSI en diciembre de 1984, elevándolo así a la categoría de estándar conjunto ANSI/IEEE 802.3.

El 1 de enero de 1984 una decisión judicial en Estados Unidos rompe el monopolio AT&T en telefonía. AT&T se subdivide en AT&T Long Lines y 23 BOCs (Bell Operating Companies). Los usuarios pasan a ser propietarios de su red telefónica interior y pueden gestionarla.

En el año 1984 el comité 802.3 empezó a estudiar la posibilidad de implementar Ethernet en cable telefónico. Por aquel entonces muchos expertos aseguraban que una red de 10 Mb/s jamás podría funcionar sobre cable de pares sin apantallar, debido a la mayor atenuación de este medio a altas frecuencias.

Ya en su artículo de 1976 Metcalfe y Boggs mencionaban la posibilidad de extender la red mediante el uso de repetidores 'filtradores de tráfico' o de paquetes.

Dec comercializa los primeros puentes transparentes. Aunque caros y de bajo rendimiento comparados con los actuales eran alternativa a los routers por su sencillez y relación precio/prestaciones.

Se publica el estándar IEEE 802.3, que ISO aceptó como DIS (Draft International Standard) en bajo la denominación ISO/IEC 8802-3, versión adaptada del IEEE 802.3. La especificación de ISO es técnicamente equivalente pero no idéntica a la de IEEE/ANSI. El documento difiere en las unidades (que están basadas en el sistema métrico), se utiliza terminología internacional, se eliminan referencias a otros estándares nacionales de Estados Unidos, y se formatea el documento para papel de tamaño ISO A4.

PRIMER ESTANDARD DEL IEEE.

– 10 Mb/s sobre un medio compartido

– Basado en “Ethernet Blue Book”

– Topologia compartida en bus.

Primeros productos 10BASE-T de Synoptics, sacó al mercado un producto denominado LattisNet que permitía utilizar cableado UTP para constituir redes Ethernet de 10 Mb/s.

El comité 802.3 estandarizó una red denominada StarLAN o 1BASE5, variante de

Ethernet que funcionaba a 1 Mb/s sobre cable de pares no apantallado (UTP) a

distancias máximas de 500 m.

El IEEE se puso en marcha para estandarizar el funcionamiento de los puentes transparentes. El resultado fue el estándar 802.1D aprobado en 1990.

En 1988 Van Jacobson (contribuye mejorar el rendimiento del TCP), envió un artículo a usenet informando que había conseguido una velocidad de transferencia de 8 Mb/s sobre Ethernet entre dos estaciones de trabajo Sun utilizando una versión optimizada de TCP. A partir de ese momento las mejoras en el hardware (CPUs, discos, tarjetas controladoras, etc.) y en el software (sistemas operativos, protocolos, etc.) empezaron a hacer cada vez mas fácil que un solo equipo saturara una Ethernet.

Para permitir mayores distancias y mejorar la conectividad entre edificios también se incluye la fibra óptica como medio de transmisión. El FOIRL (Fiber Optic Inter-Repeater Link) es incorporado al estándar 802.3 por el IEEE, y permite unir repetidores a una distancia máxima de 1000 m.

Actualmente FOIRL esta en desuso, en su lugar se emplea 10BASE-FL que permite unir repetidores y equipos con una distancia máxima de 2.000 m.

Se estandariza 10BASE-T (T = 'Twisted') que utilizaba cable de pares trenzados no apantallado (UTP, Unshielded Twisted Pair) y comunicación 10 Mbps modo half –dúplex, al ser una topología en estrella elimina todas las restricciones inherentes a la topología en bus. Esto marcó el final de StarLAN ya que la mayoría de los usuarios que habían optado provisionalmente por StarLAN migraron a 10BASE-T que ofrecía mayor velocidad y evitaba tener que utilizar costosos puentes conversores de velocidad para conectar la red de 1 Mb/s con la de 10 Mb/s.

Se aprueba el estándar 802.1d (puentes transparentes).

Primeros conmutadores Ethernet de Kalpana.

La empresa Kalpana comercializó un nuevo tipo de puentes Ethernet con un número elevado de interfaces (capaz de dar 10Mbps en cada interfaz) y alto rendimiento. Estos equipos se llaman conmutadores LAN para diferenciarlos de los tradicionales puentes, aunque su principio de funcionamiento era el mismo.

Los conmutadores LAN dan una vía de crecimiento a los usuarios de Ethernet sin necesidad de cambiar a otras tecnologías. Los conmutadores LAN producía redes en las que cada puerto era dedicado a un ordenador. Así cada usuario podía disfrutar de 10Mb/s y su tráfico no era visto por ningún otro ordenador salvo por aquel al que iba dirigido, con lo que se mejoraba el rendimiento y la seguridad de la red. El uso de redes conmutadas llevaba de una situación de medio compartido a una de medio dedicado donde ya no era necesario el uso del protocolo CSMA/CD.

Los dos medios más populares de Ethernet (10BASE-T y 10BASE-FL) ofrecen un canal físico diferente para cada sentido de la comunicación.

Debido a estas dos circunstancias se implementó Ethernet full-dúplex, que consiste en aprovechar el medio físico para establecer dos canales dedicados de 10 Mb/s, uno para cada sentido, como si se tratara de una línea punto a punto. Aunque los productos comerciales Ethernet full-dúplex están en el mercado después de la aparición de los conmutadores LAN su funcionamiento no fue estandarizado por el IEEE hasta 1997 en la especificación 802.3x, donde establece un control de flujo para su funcionamiento.

Grand Junction sacó en 1992 una versión de Ethernet que funcionaba a 100 Mb/s. Esto provocó la creación en el IEEE de un grupo de estudio sobre redes de alta velocidad, con la misión de estudiar la posibilidad de ampliar el estándar a 100 Mb/s. Obstaron por mantener el protocolo CSMA/CD en todos sus aspectos, pero aumentar en un factor 10 la velocidad de la red. Al mantener el tamaño de trama mínimo (64 bytes) se reducía en diez veces el tamaño máximo de la red, lo cual daba un diámetro máximo de unos 400 metros. El uso de CSMA/CD suponía además la ya conocida pérdida de eficiencia debida a las colisiones.Tenía la ventaja de acelerar el proceso de estandarización y el desarrollo de productos .Hoy la conocemos como Fast Ethernet, aprobado en junio de 1995. Para acelerar el proceso de estandarización se utilizaron para el nivel físico buena parte de las especificaciones ya desarrolladas por ANSI para FDDI. Los medios físicos soportados por Fast Ethernet son fibra óptica multimodo, cable UTP categoría 3 y categoría 5 y cable STP (Shielded Twisted Pair).

La red Fast Ethernet se extendió con una rapidez, produjo que bajaran los precios y su uso se popularizó hasta el usuario final.

Comercializaron los primeros conmutadores Full Dúplex.

Se estandariza Fast Ethernet 100 Mbps modo half dúplex sobre: 100BASE-FX (MMF, multimode fiber) y 100BASE-TX y 100 BASE-T4 (UTP).

El subcomité 802.3 a inicia otro grupo de trabajo que estudiara el aumento de velocidad de nuevo en un factor diez, creando lo que se denomina Gigabit Ethernet. Las previsiones de aumento en rendimiento y nivel de integración de los chips hacían prever que para 1998 sería factible construir controladores de red para esas velocidades con tecnología convencional a precios asequibles. Se inició un proceso que culminó el 29 de junio de 1998 con la aprobación del suplemento 802.3z.

Se aprueba la 'task force' 802.3z para la estandarización de Gigabit Ethernet.

Se escinde de la task force 802.3z.

Se crea un nuevo grupo de trabajo el 802.3ab para desarrollar la estandarización 1000BASE-T (Gigabit Ethernet) sobre cable UTP categoría 5.

Se aprueba el estándar Ethernet full-dúplex (802.3x), potencialmente aumenta el uso del ancho de banda, bidireccional. La tecnología full-duplex permite transmisores de 200 Mbps porque provee comunicación bidireccional a 100 Mbps, además incrementa la distancia máxima que es soportada por las fibras ópticas entre dosdispositivos DTE (Data Terminal Equipment: Dispositivos de usuarios como ordenadores y terminales, que se conectan a equipos de comunicación de datos (DCE) como módem, ruteadores, puentes, etc. )

Primeros productos comerciales Gigabit Ethernet

La necesidad de diseñar redes mas grandes llevó a la estandarización del Ethernet 1000 Mbpsn (aumentó orden de magnitud x10^2), llamado Gigabit Ethernet (GigaE), con el estándar 802.3z que comprende los medios físicos 1000BASE-T (UTP), 1000BASE-SX (Multi-Mode fiber (MMF)), 1000BASE-LX (Single-mode fiber (SMF)) y 1000BASE-CX (Coaxial).

Para mantener un alto nivel de detección de colisiones, se necesitaba cambiar la longitud mínima de las tramas, pasando de 64 octetos a 512 octetos.

El cableado más común utilizado al nivel horizontal (entre las plantas) es el cable (si es de categoría 5 o más) o la fibra óptica, y al nivel vertical (entre los servidores), se debe utilizar la fibra óptica.

Se estandariza 100BASE-SX (Fast Ethernet mediante emisores láser en primera ventana sobre fibra multimodo).

Gigabit Ethernet, empezó a ser utilizado en los centros de datos y las redes troncales y empresariales y que, actualmente, está llegando incluso a los hogares.

Se estandariza 1000BASE-TX en él se especifica Gigabit Ethernet sobre cable UTP-5 a través un grado de la categoría 5e (enhanced o mejorada: está diseñado para señales de alta integridad. Estos cables pueden ser blindados o sin blindar) y 6 (posee características y especificaciones para crosstalk ”diafonía” y ruido) en sistemas de cableado ya instalado por eso es una solución muy rentable.

Se aprueba el suplemento 802.3ab y constituye ya una realidad comercial constituyendo el medio habitual de conexión de alta capacidad dentro de entornos LAN.

Se publicó una nueva versión del estándar 802.3, 2000 edition que hace obsoleta todas las anteriores y que ya incluye las especificaciones 802.3 ab, 802.3 ac y 802.3 ad.

– LACP (Link Aggregation Control Protocol)es un protocolo que puede ser implementado en switches cisco, puede agrupar puertos por su velocidad, modo dúplex, trocales, VLAN. Tiene dos modos de configuración:

• Activo: un puerto en este estado es capaz de iniciar negociaciones con otros puertos para establecer el grupo.

• Pasivo: un puerto en este estado es un puerto que no iniciará ningún tipo de negociación pero si responderá a las negociaciones generadas por otros puertos.

Dos puertos pasivos nunca podrán formar un grupo.

– Trunking (permita a múltiples redes compartir de forma transparente el mismo medio físico, sin problemas de interferencia entre ellas)

– Mejora independiente de la velocidad.

– Permite configurar múltiples enlace físicos como un único enlace lógico de mayor velocidad.

– Posibilidad casi sin límites de escalar en velocidad.

– Mayor uso en puntos de agregación de tráfico.

Se aprobó el nuevo estándar 10 Gigabit Ethernet o versión 802.3ae (Aumento magnitud: 10^3) desarrollada por el IEEE, contiene siete tipos de medios para LAN, MAN (se usa mucho para redes metropolitanas) y WAN(Wide Área Network), y los grandes centros de datos y de servidores, muy utilizado actualmente en las redes troncales. El mayor cambio en 10 Gigabit Ethernet es que se ha eliminado el protocolo de acceso al medio CSMA/CD (Carrier Sense Multiple Access with Collision Detection), ya que se implementa tan sólo en full-dúplex (la transmisión y recepción de datos se realizan por cables distintos para evitar colisiones), con el fin de no empeorar las longitudes de los segmentos en los que se utiliza este protocolo. Por otro lado, el medio físico empleado es, por lo general, la fibra óptica. Operación solo en modo Full- Duplex.

Permite la ampliación del campo de aplicación del Ethernet a redes WAN.

Se convierte en una alternativa simple, económica y eficiente para sustituir las redes SDH/SONET. (CARRIERS ETHERNET)

Esta versión de Ethernet es totalmente compatible y tiene el mismo formato de trama que el Gigabit Ethernet.

Se estandarizo PoE (Power over Ethernet) alimentación a través de Ethernet, se rige por un estándar internacional IEEE 802.3af, es una tecnología que incorpora alimentación eléctrica a una infraestructura LAN estándar. Permite que la alimentación eléctrica se suministre a un dispositivo de red (switch, punto de acceso, router, teléfono o cámara IP, etc) usando el mismo cable que se utiliza para la conexión de red. Elimina la necesidad de utilizar tomas de corriente en las ubicaciones del dispositivo alimentado y permite una aplicación más sencilla de los sistemas de alimentación ininterrumpida (SAI) para garantizar un funcionamiento.

– Suministra energía DC de forma limitada (aprox 15W a dispositivos conectados a al red).

– Útil en condiciones donde es difícil de suministrar energía a dispositivos como:

• Hubs Inalámbricos.

• Teléfonos IP.

• Sensores varios.

• Aplicaciones Industriales.

Ethernet la ultima milla (EFM) una tecnología de acceso que permite de forma simétrica, conexiones con un mayor ancho de banda a través de la líneas de cobre.

El EFM sobre Fibra (EFMF) está dirigido a la capa física para Ethernet con fibra punto a punto ofreciendo velocidades de 100 Mbps y varios Gbps, para una distancia de al menos 10 km sobre una fibra monomodo. Además, añade soporte tanto para una sola fibra como para una doble fibra. Soporta un gran ancho de banda simétrico y enlaces full-duplex punto a punto. Por último, EMFM implementa una nueva capa física, la

PMD. Esta capa especifica la calidad y el tipo del hardware necesario, incluyendo cables, conectores…

Es una solución económica y rápida.

Las líneas telefónicas proveen velocidades de:

• 2 Mbps – 10 Mbps dedicadas (full duplex).

• Basada en VDSL (Se trata de una tecnología de acceso a internet de Banda Ancha, que transmiten los impulsos sobre pares de cobre).

Fibra:

• 1 Gbps compartido entre 16-32 clientes.

• Basada en la topología desarrollada para Passive Optical Networks (PONs, redes ópticas pasivas), permiten eliminar todos los componentes activos existentes entre el servidor y el cliente introduciendo en su lugar componentes ópticos pasivos para guiar el tráfico por la red.

Ethernet 10 gigabit desarrollada por el IEE velocidad a 10 Gbps sobre par trenzado no blindado (UTP), corresponde a la versión 802.3an.

Un grupo de fabricantes quiere sobreponer trabajos en SONET (protocolo) y STM-256/OC-768 (especificación de velocidad) para crear un 40 Gigabit Ethernet, cuando muchos otros fabricantes creen que sería mejor mantener los múltiples de 10 para crear un 100 Gigabit Ethernet. Este 100 Gigabit Ethernet en fase de estandarización con el estándar IEEE 802.3ba.

Se aprobará el IEEE 802.3ba, desde el que se llevaba trabajando desde 2006 y cuyo primer borrador apareció a finales de 2008. Este estándar da un paso más en las velocidades de Ethernet, dando lugar a dos velocidades: 40 Gbps que estará destinada a las aplicaciones de centro de proceso de datos y servidores, y las de 100 Gbps para la interconexión en las redes troncales. De este modo, 40 Gigabit Ethernet y 100 Gigabit Ethernet incrementará aún más el actual mercado de Ethernet.

MEDIO FISICO:

Los elementos de una red Ethernet son: los nodos de red y el medio de interconexión. Los nodos de red pueden clasificarse en dos grandes grupos: Equipo Terminal de Datos (DTE) y Equipo de Comunicación de Datos (DCE).

Los DTE son dispositivos de red que generan o que son el destino de los datos: como las PCs, las estaciones de trabajo, los servidores de archivos, los servidores de impresión; todos son parte del grupo de las estaciones finales.

Los DCE son los dispositivos de red intermediarios que reciben y retransmiten las tramas dentro de la red; pueden ser: ruteadores, conmutadores (switch), concentradores (hub), repetidores o interfaces de comunicación, ej.: un módem o una tarjetade interface.

Dentro de los DCE podemos dividirlos en activo y pasivos. Los primeros generan y/o modifican señales, los segundos simplemente la transmiten. Son los siguientes:

Pasivos:

Activos:

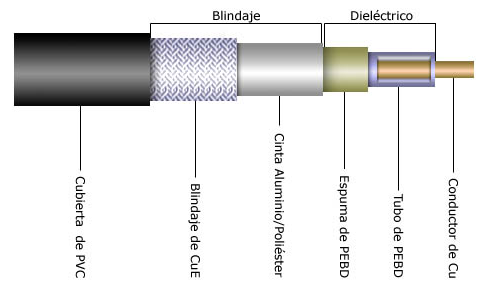

Cable coaxial

Está compuesto de un hilo conductor central de cobre rodeado por una malla de hilos de cobre. El espacio entre el hilo y la malla lo ocupa un conducto de plástico que separa los dos conductores y mantiene las propiedades eléctricas. Todo el cable está cubierto por un aislamiento de protección para reducir las emisiones eléctricas.

Su mayor defecto es su grosor, el cual limita su utilización en pequeños conductos eléctricos y en ángulos muy agudos.

El cable coaxial consiste de un núcleo sólido de cobre rodeado por un aislante, una combinación de blindaje y alambre de tierra y alguna otra cubierta protectora.

Este tipo de medio fue el primero en utilizarse para Ethernet y puede ser de dos tipos:

· Thinnet: Grosor de 1/4" o menor, comúnmente utilizado en diseños

10Base2 para ambientes ARCnet. Distancia Máxima de 185 m, el cableado utilizado para Thinnet es por lo general tipo RG-58.

· Thicknet: Comúnmente conocido como “cable amarillo” utilizado para "backbones" su tamaño es de 3/8" (.375 pulgadas),utilizado en backbones de televisión y en diseños 10Base5, su distancia máxima entre centrales es de 500 mt.

El cable coaxial a diferencia del cableado Ethernet que comúnmente es utilizado hoy en día, utiliza conectores llamados "BNC" (British Naval Conectors), que es una "T" con orificios muy similares a los que son utilizados por un TV con cable.

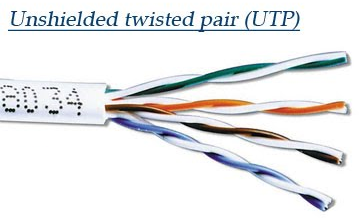

Cable Empalmado "Twisted Pair"

El cable twisted pair son un par de cables trenzado que cuentan con un método de cableado en el que dos cables conductores se trenzan uno con el otro con el objetivo de cancelar campos de interferencia electromagnéticas y ruido proveniente de fuentes externas o de otros cables cercanos.

El cable de par entorchado tiene uno o más pares “abrazados” uno a otro (esto ayuda a cancelar polaridades e intensidades opuestas).

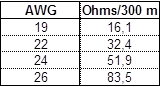

· Los hilos son referenciados con respecto a su grosor utilizando los números de American Wire Gauge

· Los alambres delgados tienen más resistencia que los gruesos.

Puede ser de dos tipos:

· UTP: Significa que el cable no tiene capa protectora, UTP puede extenderse a una distancia máxima de 100 metros, es utilizado primordialmente para Ethernet

· STP: Utiliza un capa protectora para cada cable para limitar interferencia, permite una mayor distancia que UTP (aunque limitadas), comúnmente utilizado en ARCnet o Redes IBM.

Este tipo de cableado es el que se encuentra en mayor uso y puede ser de categorias:

• Categoría 1: (UTP) Apto únicamente para voz, utilizado para transmisiones comunes de telefonía. Alambre sólido 22 ó 24 AWG: no se puede utilizar para transmisión de datos: 56 Kbps

• Categoría 2: (UTP) No es muy utilizado, su velocidad máxima de transmisión es 4 Mbps. Alambre sólido 22 ó 24 AWG para teléfonos y sistemas de alarmas: 1 MHz

• Categoría 3: (UTP o STP) Óptimo para transmisiones 10BaseT, velocidad máxima hasta 10 Mbps. Alambre sólido 24 AWG, 100 Ohmios, 16 MHz.

• Categoría 4: (UTP o STP) Velocidad máxima 16 Mbps, comúnmente utilizado en un ambiente Token Ring de IBM. Alambre sólido 24 AWG, 100 Ohmios, 20MHz.

• Categoría 5: (UTP o STP) Alcanza velocidades de 100 Mbps, utilizado para Fast Ethernet. Par trenzado de 22 ó 24 AWG, impedancia de 100 Ohmios, ancho de banda de 100 MHz (usa conector RJ45 -8P8C-). Atenuación inferior a 24 dB y Next superior 27.1 dB para 100 MHz.

• Categoría 5e (enhanced) puede transportar, de forma fiable, hasta 125 Mbps de tráfico, obtener 1000 Mbps de ancho de banda fue un desafío de diseño, el mismo ISO Clase D: Par trenzado 22 ó 24 AWG, ancho de banda 100 MHz. Atenuación 24 dB. Next 30.1 dB se utiliza en redes de ordenadores Gigabit Ethernet.

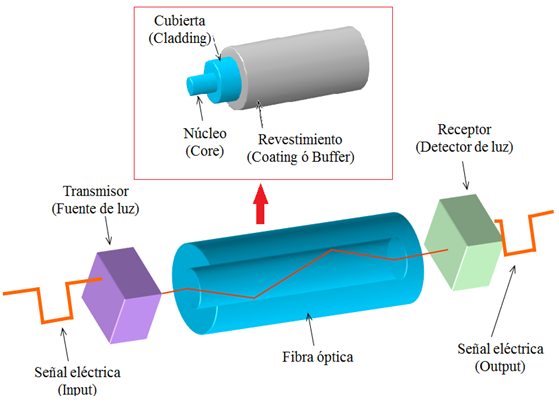

Fibra óptica

Transmite energía en forma de luz. Permite tener anchos de banda muy altos (billones de bits por segundo).

En los sistemas de cableado, la fibra óptica puede utilizarse tanto en el subsistema vertical como en el horizontal.

La luz no se escapa del núcleo porque la cubierta y el núcleo están hechos de diferentes tipos de vidrio (y por tanto tienen diferentes índices de refracción). Esta diferencia en los índices obliga a que la luz sea reflejada cuando toca la frontera entre el núcleo y la cubierta.

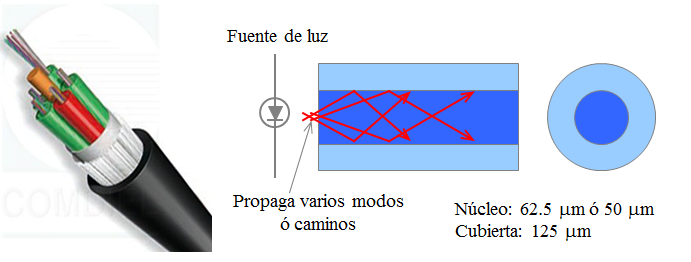

Existen dos tipos de fibra óptica:

MULTIMODO:

Usada generalmente para comunicación de datos. Tiene un núcleo grande (más fácil de acoplar). En este tipo de fibra muchos rayos de luz (ó modos) se pueden propagar simultáneamente. Cada modo sigue su propio camino. La máxima longitud recomendada del cable es de 2 Km.

Los fabricantes de fibra multimodo especifican cuánto afecta la dispersión modal a la señal estableciendo un producto ancho de banda-longitud (o ancho de banda).

› Una fibra de 200MHz-km puede llevar una señal a 200 MHz hasta un Km de distancia ó 100 MHz en 2 km.

La dispersión modal varía de acuerdo con la frecuencia de la luz utilizada. Se deben revisar las especificaciones del fabricante

› Un rango de ancho de banda muy utilizado en fibra multimodo para datos es 62.5/125 con 160 MHz-km en una longitud de onda de 850 nm.

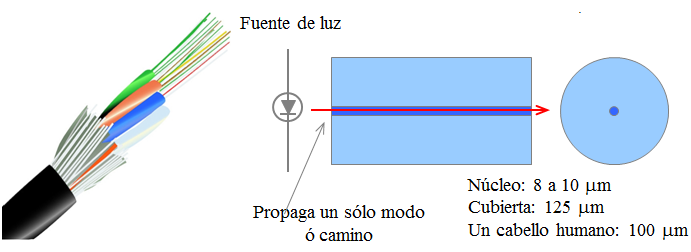

MONOMODO:

Tiene un núcleo más pequeño que la fibra multimodo. En este tipo de fibra sólo un rayo de luz (ó modo) puede propagarse a la vez. Es utilizada especialmente para telefonía y televisión por cable. Permite transmitir a altas velocidades y a grandes distancias (40 km).

La fibra monomodo no tiene dispersión modal, por eso no se especifica el producto ancho de banda-longitud.

La perdida de potencia óptica, o atenuación, se expresa en dB/km (aunque la parte de “km” se asume y es dada sólo en dB)

› Cuantos más conectores se tengan, o más largo sea el cable de fibra, mayor perdida de potencia habrá.

› Si los conectores están mal empatados, o si están sucios, habrá más pérdida de potencia. (por eso se deben usar protectores en las puntas de fibra no utilizadas).

› Un certificador con una fuente de luz incoherente (un LED) muestra un valor de atenuación mayor que uno con luz de LASER (¡Gigabit utiliza LASER! Por eso la F.O. para gigabit debe certificarse con ese tipo de fuente de luz, no con el otro).

LOS NODOS: generalmente son computadores de propósito general (aunque los routers y switches utilizan hardware especial, los diferencia lo que hace el software).

Conmutador o Switch

Es un dispositivo digital lógico de interconexión de redes de computadoras que opera en la capa de enlace de datos del modelo OSI. Su función es interconectar dos o más segmentos de red, de manera similar a los puentes de red, pasando datos de un segmento a otro de acuerdo con la dirección MAC de destino de las tramas en la red.

Los conmutadores se utilizan cuando se desea conectar múltiples redes, fusionándolas en una sola. Al igual que los puentes, dado que funcionan como un filtro en la red, mejoran el rendimiento y la seguridad de las redes de área local.

Los conmutadores poseen la capacidad de aprender y almacenar las direcciones de red de la capa 2 (direcciones MAC) de los dispositivos alcanzables a través de cada uno de sus puertos. Por ejemplo, un equipo conectado directamente a un puerto de un conmutador provoca que el conmutador almacene su dirección MAC. Esto permite que, a diferencia de los concentradores, la información dirigida a un dispositivo vaya desde el puerto origen al puerto de destino.

En el caso de conectar dos conmutadores o un conmutador y un concentrador, cada conmutador aprenderá las direcciones MAC de los dispositivos accesibles por sus puertos, por lo tanto en el puerto de interconexión se almacenan las MAC de los dispositivos del otro conmutador.

Como anteriormente se comentaba, uno de los puntos críticos de estos equipos son los bucles, que consisten en habilitar dos caminos diferentes para llegar de un equipo a otro a través de un conjunto de conmutadores. Los bucles se producen porque los conmutadores que detectan que un dispositivo es accesible a través de dos puertos emiten la trama por ambos. Al llegar esta trama al conmutador siguiente, este vuelve a enviar la trama por los puertos que permiten alcanzar el equipo. Este proceso provoca que cada trama se multiplique de forma exponencial, llegando a producir las denominadas inundaciones de la red, provocando en consecuencia el fallo o caída de las comunicaciones.

Beneficios Clave

Ideales para las aplicaciones siguientes:

La diferencia principal entre los hubs y los switches se basa en la forma en que ellos distribuyen los paquetes a través de la red, lo cual afecta directamente los costos y la disponibilidad del ancho de banda. Esta diferencia se refleja en la siguiente figura:

Cuando utilizar un switch:

Tipos de Switch:

Store-and-Forward

Los conmutadores Store-and-Forward guardan cada trama en un búfer antes del intercambio de información hacia el puerto de salida. Mientras la trama está en el búfer, el switch calcula el CRC y mide el tamaño de la misma. Si el CRC falla, o el tamaño es muy pequeño o muy grande (un cuadro Ethernet tiene entre 64 bytes y 1518 bytes) la trama es descartada. Si todo se encuentra en orden es encaminada hacia el puerto de salida.

Este método asegura operaciones sin error y aumenta la confianza de la red. Pero el tiempo utilizado para guardar y chequear cada trama añade un tiempo de demora importante al procesamiento de las mismas. La demora o delay total es proporcional al tamaño de las tramas: cuanto mayor es la trama, más tiempo toma este proceso.

Cut-Through

Los conmutadores cut-through fueron diseñados para reducir esta latencia. Esos switches minimizan el delay leyendo sólo los 6 primeros bytes de datos de la trama, que contiene la dirección de destino MAC, e inmediatamente la encaminan.

El problema de este tipo de switch es que no detecta tramas corruptas causadas por colisiones (conocidos como runts), ni errores de CRC. Cuanto mayor sea el número de colisiones en la red, mayor será el ancho de banda que consume al encaminar tramas corruptas.

Existe un segundo tipo de switch cut-through, los denominados fragment free, fue proyectado para eliminar este problema. El switch siempre lee los primeros 64 bytes de cada trama, asegurando que tenga por lo menos el tamaño mínimo, y evitando el encaminamiento de runts por la red.

Adaptative Cut-Through

Son los conmutadores que procesan tramas en el modo adaptativo y son compatibles tanto con store-and-forward como con cut-through. Cualquiera de los modos puede ser activado por el administrador de la red, o el switch puede ser lo bastante inteligente como para escoger entre los dos métodos, basado en el número de tramas con error que pasan por los puertos.

Cuando el número de tramas corruptas alcanza un cierto nivel, el conmutador puede cambiar del modo cut-through a store-and-forward, volviendo al modo anterior cuando la red se normalice.

Los conmutadores cut-through son más utilizados en pequeños grupos de trabajo y pequeños departamentos. En esas aplicaciones es necesario un buen volumen de trabajo o throughput, ya que los errores potenciales de red quedan en el nivel del segmento, sin impactar la red corporativa.

Los conmutadores store-and-forward son utilizados en redes corporativas, donde es necesario un control de errores.

Atendiendo a la forma de segmentación de las subredes

Conmutadores de la capa 2

Son los conmutadores tradicionales, que funcionan como puentes multi-puertos. Su principal finalidad es dividir una LAN en múltiples dominios de colisión, o en los casos de las redes en anillo, segmentar la LAN en diversos anillos. Basan su decisión de envío en la dirección MAC destino que contiene cada trama.

Los conmutadores de la capa 2 posibilitan múltiples transmisiones simultáneas sin interferir en otras sub-redes. Los switches de capa 2 no consiguen, sin embargo, filtrar difusiones o broadcasts, multicasts (en el caso en que más de una sub-red contenga las estaciones pertenecientes al grupo multicast de destino), ni tramas cuyo destino aún no haya sido incluido en la tabla de direccionamiento.

Conmutadores de la capa 3

Son los conmutadores que, además de las funciones tradicionales de la capa 2, incorporan algunas funciones de enrutamiento o routing, como por ejemplo la determinación del camino basado en informaciones de capa de red (capa 3 del modelo OSI), validación de la integridad del cableado de la capa 3 por checksum y soporte a los protocolos de routing tradicionales (RIP, OSPF, etc)

Los conmutadores de capa 3 soportan también la definición de redes virtuales (VLAN), y según modelos posibilitan la comunicación entre las diversas VLAN sin la necesidad de utilizar un router externo.

Por permitir la unión de segmentos de diferentes dominios de difusión o broadcast, los switches de capa 3 son particularmente recomendados para la segmentación de redes LAN muy grandes, donde la simple utilización de switches de capa 2 provocaría una pérdida de rendimiento y eficiencia de la LAN, debido a la cantidad excesiva de broadcasts.

Se puede afirmar que la implementación típica de un switch de capa 3 es más escalable que un enrutador, pues éste último utiliza las técnicas de enrutamiento a nivel 3 y enrutamiento a nivel 2 como complementos, mientras que los switches sobreponen la función de enrutamiento encima del encaminamiento, aplicando el primero donde sea necesario.

Dentro de los conmutador de la capa 3 tenemos:

Básicamente, un conmutador paquete por paquete (packet by packet en inglés) es un caso especial de un conmutador Store-and-Forward pues, al igual que este, almacena y examina el paquete, calculando el CRC y decodificando la cabecera de la capa de red para definir su ruta a través del protocolo de enrutamiento adoptado.

Un conmutador de la capa 3 Cut-Through (no confundir con un conmutador Cut-Through), examina los primeros campos, determina la dirección de destino (a través de la información de los headers o cabeceras de capa 2 y 3) y, a partir de ese instante, establece una conexión punto a punto (a nivel 2) para conseguir una alta tasa de transferencia de paquetes.

Cada fabricante tiene su diseño propio para posibilitar la identificación correcta de los flujos de datos. Como ejemplo, tenemos el "IP Switching" de Ipsilon, el "SecureFast Virtual Networking de Cabletron", el "Fast IP" de 3Com.

El único proyecto adoptado como un estándar de hecho, implementado por diversos fabricantes, es el MPOA (Multi Protocol Over ATM). El MPOA, en desmedro de su comprobada eficiencia, es complejo y bastante caro de implementar, y limitado en cuanto a backbones ATM.

Además, un switch Layer 3 Cut-Through, a partir del momento en que la conexión punto a punto es establecida, podrá funcionar en el modo "Store-and-Forward" o "Cut-Through"

Conmutadores de la capa 4

Están en el mercado hace poco tiempo y hay una controversia en relación con la clasificación adecuada de estos equipos. Muchas veces son llamados de Layer 3+ (Layer 3 Plus).

Básicamente, incorporan a las funcionalidades de un conmutador de la capa 3; la habilidad de implementar la políticas y filtros a partir de informaciones de la capa 4 o superiores, como puertos TCP/UDP, SNMP, FTP, etc.

Hub

Son los más básicos bloques de construcción para la conexión de ordenadores, servidores, y dispositivos periféricos en una red. Se utilizan como repetidores o concentradores. En este caso son asignados a dispositivos en la red para que se comuniquen unos con otros, compartiendo información y recursos.

Son utilizados para conectar dos o más segmentos Ethernet de cualquier tipo de medio. A medida que los segmentos exceden su longitud máxima, la calidad de la señal comienza a deteriorarse. Los hubs proveen la amplificación de señal requerida para permitirle a un segmento extenderse a una distancia mayor. Toma cualquier señal entrante y la repite a todos los restantes puertos de salida.

Los hubs Ethernet trabajan necesariamente en topologías estrella tales como 10BASE-T y 100BASE-T. Hay parejas separadas para transmitir y recibir, pero que se utilizan en modo half duplex el cual se comporta todavía como un medio de enlaces compartidos. Un hub multi-puerto de par trenzado, permite que varias conexiones de segmentos “punto-a-punto” se reúnan en una red. Un extremo del vínculo “punto-a-punto” es conectado al hub y el otro es conectado al ordenador. Si el hub es conectado al backbone, entonces todos los ordenadores en los extremos de los segmentos de par trenzado pueden comunicarse con todos los “hosts” del backbone.

El número y tipo de hubs en cualquier dominio de colisión está limitado por las reglas de Ethernet. Un hecho muy importante a tener en cuenta acerca de los hubs es que ellos solamente permiten a los usuarios compartir Ethernet.

Los concentradores no logran dirigir el tráfico que llega a través de ellos, y cualquier paquete de entrada es transmitido a otro puerto (que no sea el puerto de entrada). Dado que cada paquete está siendo enviado a través de cualquier otro puerto, aparecen las colisiones de paquetes como resultado, que impiden en gran medida la fluidez del tráfico. Cuando dos dispositivos intentan comunicar simultáneamente, ocurrirá una colisión entre los paquetes transmitidos, que los dispositivos transmisores detectan. Al detectar esta colisión, los dispositivos dejan de transmitir y hacen una pausa antes de volver a enviar los paquetes.

La necesidad de host para poder detectar las colisiones limita el número de centros y el tamaño total de la red. Para 10 Mbit/s en redes, de hasta 5 segmentos (4 concentradores) se permite entre dos estaciones finales. Para 100 Mbit/s en redes, el límite se reduce a 3 segmentos (2 concentradores) entre dos estaciones finales, e incluso sólo en el caso de que los concentradores fueran de la variedad de baja demora. Algunos concentradores tienen puertos especiales (y, en general, específicos del fabricante) les permiten ser combinados de un modo que consiente encadenar a través de los cables Ethernet los concentradores más sencillos, pero aun así una gran red Fast Ethernet es probable que requiera conmutadores para evitar el encadenamiento de concentradores.

La mayoría de los concentradores detectan problemas típicos, como el exceso de colisiones en cada puerto. Así, un concentrador basado en Ethernet, generalmente es más robusto que el cable coaxial basado en Ethernet. Incluso si la partición no se realiza de forma automática, un concentrador de solución de problemas la hace más fácil ya que las luces puede indicar el posible problema de la fuente. Asimismo, elimina la necesidad de solucionar problemas de un cable muy grande con múltiples tomas.

Una red de hubs se la denomina como “shared Ethernet”, significando que todos los miembros de la red están habilitados para transmisión de datos sobre una red única (o dominio de colisión). Esto quiere decir que los miembros individuales de una red compartida obtendrán solo un porcentaje del ancho de banda total disponible. También se debe mencionar que los repetidores permiten a las redes extenderse más allá de las limitaciones normales de distancia, pero se encuentran aún limitados en el número de nodos que pueden ser soportados.

Usos

Históricamente, la razón principal para la compra de concentradores en lugar de los conmutadores era el precio. Esto ha sido eliminado en gran parte por las reducciones en el precio de los conmutadores, pero los concentradores aún pueden ser de utilidad en circunstancias especiales:

Cuando utilizar un hub:

Puente o Bridge

La función de un bridge (“puente”) es conectar redes separadas uniéndolas. Los bridges pueden conectar diferentes tipos de redes o redes del mismo tipo. Los bridges “mapean” las direcciones Ethernet de los nodos que residen en cada segmento de red y luego permiten pasar a través del “puente” solamente el tráfico necesario.

Cuando un paquete es recibido por el bridge, este determina los segmentos de origen y destino. Si estos segmentos coinciden, el paquete es descartado (“dropped” o “filtered”); si los segmentos son distintos, entonces el paquete es transferido al segmento correcto.

Adicionalmente, los bridges evitan que paquetes malos o dañados se distribuyan innecesariamente simplemente no re-transmitiéndolos. Los bridges son llamados dispositivos “store-and-forward” (almacena y envía) porque ellos examinan el contenido del paquete Ethernet completo antes de realizar las decisiones de filtrado o envío. El filtrado de paquetes y la regeneración de paquetes enviados permite a la tecnología de bridging partir una red en dominios de colisión separados. Esto permite mayores distancias y que más repetidores sean utilizados en el diseño total de la red.

La mayoría de los bridges son “self learning task bridges”, lo que quiere decir que ellos determinan la dirección Ethernet del usuario en el segmento construyendo una tabla a medida que los paquetes son pasados a través de la red. Esta capacidad de auto-aprender eleva dramáticamente la posibilidad de crear “loops” o caminos circulares en redes que poseen un gran número de bridges.

Dado que cada dispositivo aprende la configuración de la red, un camino en círculo o “loop” presenta información conflictiva sobre en cual segmento está localizada una dirección específica y fuerza entonces al dispositivo a enviar todo el tráfico. El algoritmo de “Spanning Tree” es un estándar de software (puede encontrárselo dentro de la especificación IEEE 802.1d) que describe como switches y bridges pueden comunicarse para evitar caminos circulares o “loops” en las redes.

Para clasificar los bridges, atenderemos a dos aspectos: los tipos de interfaz y la localización geográfica de las LAN que se van a interconectar.

Según el interfaz

Según la localización geográfica

Ventajas

Desventajas

Repetidores

Los repetidores se emplean para conectar dos o más segmentos Ethernet de cualquier tipo de medio físico. Según los segmentos exceden el máximo número de nodos o la longitud máxima, la calidad de las señales empieza a deteriorarse. Los repetidores proporcionan la amplificación y resincronización de las señales necesarias para conectar los segmentos. Al partir un segmento en dos o más subsegmentos, permitimos a la red continuar creciendo. Una conexión de repetidor cuenta en el límite del número total de nodos de cada segmento. Por ejemplo, un segmento de cable coaxial fino puede tener 185 metros de longitud y hasta 29 nodos o estaciones y un repetidor, ya que el número total de nodos es de 30 por segmento. Un segmento de cable coaxial grueso puede tener 500 metros, 98 nodos y 2 repetidores (para un total de 100 nodos por segmento).

Los repetidores Ethernet son necesarios en las topologías de estrella. Como hemos indicado, una red con sólo dos nodos está limitada. Un repetidor de par trenzado permite a diversos segmentos "punto a punto" unirse en una sola red. Un extremo del enlace punto a punto se conecta al repetidor y el otro al ordenador con un transceptor. Si el repetidor está conectado al troncal, entonces todos los ordenadores conectados en los extremos de los segmentos de par trenzado pueden comunicar con todos los servidores del troncal.

Los repetidores también monitorizan todos los segmentos conectados para verificar que la red funciona correctamente. Cuando algo falla en un determinado segmento, por ejemplo se produce una rotura, todos los segmentos Ethernet puede quedar inoperantes. Los repetidores limitan el efecto de estos problemas, a la sección de cable rota, "segmentando" la red, desconectando el segmento problemático y permitiendo al resto seguir funcionando correctamente. La avería de un segmento en una red punto a punto, habitualmente, sólo desactivará un ordenador, lo que en una topología de bus ocasionaría la desactivación de todos los nodos del segmento.

Al igual que los diferentes medios de Ethernet tienen diferentes limitaciones, los grandes segmentos creados con repetidores y múltiples segmentos, también tienen restricciones. Estas restricciones, generalmente tienen que ver con los requisitos de sincronización. A pesar de que las señales eléctricas que circulan por los medios Ethernet, viajan a cerca de la velocidad de la luz, aún requieren un tiempo finito para viajar de un extremo de una gran red a otro. Las normas Ethernet asumen que no va a llevar más de un determinado tiempo para que una señal sea propagada entre los extremos más alejados de la red. Si la red es excesivamente grande, esta presunción no se cumple, y la red no funcionará correctamente. Los problemas de sincronización no pueden ser tomados a la ligera. Cuando las normas Ethernet son violadas, se pierden los paquetes, las prestaciones de la red se ven afectadas, y las aplicaciones se enlentecen y pueden fallar.

Las especificaciones IEEE 802.3 describen las reglas para el número máximo de repetidores que pueden ser usados en una configuración. El número máximo de repetidores que pueden encontrarse en el camino de transmisión entre dos nodos es de cuatro; el máximo número de segmentos de red entre dos nodos es cinco, con la restricción adicional de que no más de tres de esos cinco segmentos pueden tener otras estaciones de red conectadas a ellos (los otros segmentos deben de ser enlaces entre repetidores, que simplemente conectan repetidores). Estas reglas son determinadas por cálculos de las máximas longitudes de cables y retardos de repetidores. Las redes que las incumplen puede que aún funcionen, pero están sujetas a fallos esporádicos o problemas frecuentes de naturaleza indeterminada. Además, usando repetidores, simplemente extendemos la red a un tamaño mayor. Cuando esto ocurre, el ancho de banda de la red puede resultar un problema; en este caso, los puentes, conmutadores y encaminadores pueden usarse para particionar una gran red en segmentos más pequeños que operan más eficazmente.

Router

Un router o para algunos que utilizan el término enrutador, según el gusto del usuario, viene a ser un dispositivo de hardware que permite la interconexión de red entre ordenadores que opera en la capa tres.

Dicho de otra forma más sencilla, un router o enrutador es un dispositivo que asegura el enrutamiento de paquetes entre redes, o bien determinar la ruta exacta que debería tomar el paquete de datos que intercambiamos.

Por este motivo, los denominados como protocolos de enrutamiento son aquellos que utilizan los routers para comunicarse entre sí, y de esta forma, para permitir el compartimiento de la información, tomando por ende la decisión de cual es la ruta más adecuada en cada momento para enviar un paquete y así disfrutemos de la velocidad de internet con total confianza.

Además, algo que todos deberíamos de saber para conocer mejor su funcionamiento, los router trabajan en dos tipos de planos bien distintos: el plano de control, y el plano de reenvío o también llamado plano de datos.

Tipos de router

Aunque son muchos usuarios los que lo desconocen, en la actualidad existen distintos tipos de router que pueden utilizarse para muy diversas cuestiones. Hay routers que se encargan de proporcionar conectividad dentro de las empresas, entre Internet y las propias empresas en sí, o bien en el interior los ISP en nuestra casa.

Los encaminadores se utilizan con frecuencia en los hogares para conectar a un servicio de banda ancha, tales como IP sobre cable o ADSL. Un encaminador usado en una casa puede permitir la conectividad a una empresa a través de una red privada virtual segura.

Si bien son funcionalmente similares a los encaminadores, los encaminadores residenciales usan traducción de dirección de red en lugar de direccionamiento.

En lugar de conectar ordenadores locales a la red directamente, un encaminador residencial debe hacer que los ordenadores locales parezcan ser un solo equipo.

En las empresas se pueden encontrar encaminadores de todos los tamaños. Si bien los más poderosos tienden a ser encontrados en ISPs, instalaciones académicas y de investigación, pero también en grandes empresas.

El modelo de tres capas es de uso común, no todos de ellos necesitan estar presentes en otras redes más pequeñas.

Una captura de pantalla de la interfaz web de LuCI OpenWrt.

Los encaminadores de acceso, incluyendo SOHO, se encuentran en sitios de clientes como sucursales que no necesitan de enrutamiento jerárquico de los propios. Normalmente, son optimizados para un bajo costo.

Los encaminadores de distribución agregan tráfico desde encaminadores de acceso múltiple, ya sea en el mismo lugar, o de la obtención de los flujos de datos procedentes de múltiples sitios a la ubicación de una importante empresa. Los encaminadores de distribución son a menudo responsables de la aplicación de la calidad del servicio a través de una WAN, por lo que deben tener una memoria considerable, múltiples interfaces WAN, y transformación sustancial de inteligencia.

También pueden proporcionar conectividad a los grupos de servidores o redes externas.En la última solicitud, el sistema de funcionamiento del encaminador debe ser cuidadoso como parte de la seguridad de la arquitectura global. Separado del encaminador puede estar un cortafuegos o VPN concentrador, o el encaminador puede incluir estas y otras funciones de seguridad.Cuando una empresa se basa principalmente en un campus, podría no haber una clara distribución de nivel, que no sea tal vez el acceso fuera del campus.

En tales casos, los encaminadores de acceso, conectados a una red de área local (LAN), se interconectan a través del Core routers.

En las empresas, el core routers puede proporcionar una "columna vertebral" interconectando la distribución de los niveles de los encaminadores de múltiples edificios de un campus, o a las grandes empresas locales.Tienden a ser optimizados para ancho de banda alto.

Cuando una empresa está ampliamente distribuida sin ubicación central, la función del core router puede ser asumido por el servicio de WAN al que se suscribe la empresa, y la distribución de encaminadores se convierte en el nivel más alto.

Los encaminadores de borde enlazan sistemas autónomos con las redes troncales de Internet u otros sistemas autónomos, tienen que estar preparados para manejar el protocolo BGP y si quieren recibir las rutas BGP, deben poseer una gran cantidad de memoria.

A pesar de que tradicionalmente los encaminadores solían tratar con redes fijas (Ethernet, ADSL, RDSI...), en los últimos tiempos han comenzado a aparecer encaminadores que permiten realizar una interfaz entre redes fijas y móviles (WiFi, GPRS, Edge, UMTS, WiMAX...) Un encaminador inalámbrico comparte el mismo principio que un encaminador tradicional. La diferencia es que éste permite la conexión de dispositivos inalámbricos a las redes a las que el encaminador está conectado mediante conexiones por cable. La diferencia existente entre este tipo de encaminadores viene dada por la potencia que alcanzan, las frecuencias y los protocolos en los que trabajan.

En Wi-Fi estas distintas diferencias se dan en las denominaciones como clase a/b/g/ y n.

Tarjeta de red

Las tarjetas de red (también denominadas adaptadores de red, tarjetas de interfaz de red o NIC) actúan como la interfaz entre un ordenador y el cable de red. La función de la tarjeta de red es la de preparar, enviar y controlar los datos en la red.

Por lo general, una tarjeta de red posee dos luces indicadoras (LED):

• La luz verde corresponde a la alimentación eléctrica;

• La luz naranja (10 Mb/s) o roja (100 Mb/s) indica actividad en la red (envío o recepción de datos). Para preparar los datos que se deben enviar, la tarjeta de red utiliza un transceptor, que transforma a su vez los datos paralelos en datos en serie. Cada tarjeta posee una dirección única denominada dirección MAC, asignada por el fabricante de la tarjeta, lo que la diferencia de las demás tarjetas de red del mundo.

Las tarjetas de red presentan configuraciones que pueden modificarse. Algunas de estas son: los interruptores de hardware (IRQ) la dirección de E/S y la dirección de memoria (DMA).

Para asegurar la compatibilidad entre el ordenador y la red, la tarjeta debe poder adaptarse a la arquitectura del bus de datos del ordenador y debe poseer un tipo de conexión adecuado al cable. Cada tarjeta está diseñada para funcionar con un tipo de cable específico. Algunas tarjetas incluyen conectores de interfaz múltiples (que se pueden configurar con caballetes, conmutadores DIP o software). Los conectores utilizados con más frecuencia son los RJ-45. Nota: Algunas topologías de red patentadas que utilizan cables de par trenzado suelen recurrir a conectores RJ-11. En algunos casos, estas topologías se denominan "pre-10BaseT".

Por último, para asegurar la compatibilidad entre el ordenador y la red, la tarjeta debe ser compatible con la estructura interna del ordenador (arquitectura de bus de datos) y debe tener el tipo de conector adecuado para el cable que se está utilizando.

¿Cuál es el rol de una tarjeta de red?

Una tarjeta de red es la interfaz física entre el ordenador y el cable. Convierte los datos enviados por el ordenador a un formato que puede ser utilizado por el cable de red, transfiere los datos a otro ordenador y controla a su vez el flujo de datos entre el ordenador y el cable. También traduce los datos que ingresan por el cable a bytes para que el CPU del ordenador pueda leerlos. De esta manera, la tarjeta de red es una tarjeta de expansión que se inserta a su vez en la ranura de expansión.

Preparación de datos

Las rutas que toman los datos en un ordenador se denominan "buses". Muchas rutas simultáneas hacen que los datos se desplacen en paralelo y no en forma serial (uno después del otro).

• Los primeros buses transportaban 8 bits por vez.

• El ordenador IBM PC/AT introdujo el primer bus de 16 bits.

• Actualmente, la mayoría de los buses son de 32 bits. Sin embargo, los datos viajan en cables en series (sólo un canal) y se mueven en un solo sentido. El ordenador puede enviar O recibir datos, pero no puede efectuar ambas operaciones en forma simultánea. De esta manera, la tarjeta de red reestructura un grupo de datos que llega en paralelo y los convierte en una secuencia de datos en serie (1 bit).

Es por esta razón que se transforman las señales digitales en señales eléctricas u ópticas capaces de viajar por los cables de red. El dispositivo encargado de esta transformación se denomina transceptor.

El rol del identificador

• La tarjeta convierte datos e indica su dirección al resto de la red para que pueda distinguirse de las otras tarjetas de red.

• Direcciones MAC: definidas por el IEEE (Instituto de Ingenieros en Electricidad y Electrónica), que asigna intervalos de direcciones para cada fabricante de tarjetas de redes.

• Están inscriptas en los chips de las tarjetas; cada tarjeta posee una dirección MAC que le es propia y, por lo tanto, única en la red.

Otras funciones de las tarjetas de red

El ordenador y la tarjeta deben comunicarse entre sí para que puedan proceder al intercambio de información. De esta manera, el ordenador asigna parte de su memoria a las tarjetas que tienen DMA (Acceso directo a la memoria).

La interfaz de la tarjeta indica que otro ordenador está solicitando datos del ordenador. El bus del ordenador transfiere los datos de la memoria del ordenador a la tarjeta de red.

Si los datos se desplazan demasiado rápido como para que el adaptador proceda a su procesamiento, se colocan en la memoria del búfer de la tarjeta (RAM), donde se almacenan temporalmente mientras se siguen enviando y recibiendo los datos.

Envío y control de los datos

Antes de que la tarjeta de red que envía los datos los transmita, dialoga electrónicamente con la tarjeta de recepción con el objetivo de solucionar los siguientes temas:

• Tamaño máximo de los bloques que se enviarán

• Cantidad de datos a enviar antes de enviar la confirmación

• Intervalos entre transmisiones de datos parciales

• Período de espera antes de enviar la confirmación

• Cantidad de datos que cada tarjeta puede contener antes de verse desbordada

• Velocidad de la transmisión de datos Si una tarjeta más reciente y avanzada se comunica con una más lenta, se verán obligadas a compartir la misma velocidad de transmisión. Algunas tarjetas poseen circuitos que le permiten ajustarse a las velocidades de transmisión de cartas más lentas.

Existe entonces una aceptación y un ajuste de las configuraciones propias a cada una, antes de que se puedan enviar y recibir los datos.

Parámetros de configuración de la tarjeta

Las tarjetas de red presentan opciones de configuración: Entre ellas:

• Interrupción (IRQ): en la mayoría de los casos, las tarjetas de red utilizan las IRQ 3 y 5. Se recomienda utilizar la IRQ 5 (si está disponible); la mayoría de las tarjetas la utilizan de manera predeterminada.

• Dirección base de entrada/salida (E/S): cada dispositivo debe tener una dirección diferente para el puerto correspondiente.

• Dirección de memoria: designa la ubicación de la memoria RAM en el ordenador. La tarjeta de red utiliza esta ranura como búfer la información que entra y sale. Esta configuración puede denominarse Dirección de inicio de RAM. Por lo general, la dirección de la memoria de la tarjeta es D8000. En algunas tarjetas se suele omitir el último 0. Se debe tener cuidado de no elegir de no elegir una dirección que ya esté siendo utilizada por otro dispositivo. Sin embargo, debe tenerse en cuenta que, en ocasiones, algunas tarjetas de red no poseen una dirección de memoria configurable porque no usan las direcciones de la memoria RAM del equipo.

• El transceptor

Transceptores

Para conectar nodos a los diversos medios físicos Ethernet se usan transceptores. La mayoría de los ordenadores y tarjetas de interfaz de red incorporan, en su electrónica, un transceptor 10BASE-T o 10BASE2, permitiéndoles ser conectados directamente a Ethernet sin requerir un transceptor externo. Otros dispositivos compatibles Ethernet, más viejos, incorporan un conector AUI para permitir al usuario conectarlo a cualquier medio físico, a través de un transceptor externo. El conector AUI consiste en un conector de tipo DB de 15 pines, hembra en el lado del ordenador, macho en el lado del transceptor. Los cables coaxiales gruesos (10BASE5) también usan transceptores para permitir las conexiones.

Para las redes Fast Ethernet, se desarrolló una interfaz llamada MII (Media Independent Interface o interfaz independiente de medios) para ofrecer un modo flexible de soportar medios de 100 Mbps. MII es un modo popular de conectar enlaces 100BASE-FX a los dispositivos Fast Ethernet basados en cobre.

Los protocolos de red son normas que permiten a los ordenadores comunicarse. Un protocolo define la forma en que los ordenadores deben identificarse entre si en una red, la forma en que los datos deben transitar por la red, y cómo esta información debe procesarse una vez que alcanza su destino final. Los protocolos también definen procedimientos para gestionar transmisiones o "paquetes" perdidos o dañados. IPX (para Novell NetWare), TCP/IP (para UNIX, WindowsNT, Windows 95/98 y otras plataformas), DECnet (para conectar una red de ordenadores Digital), AppleTalk (para los ordenadores Macintosh), y NetBIOS/NetBEUI (para redes LAN Manager y WindowsNT) son algunos de los protocolos más populares en la actualidad.

Aunque cada protocolo de la red es diferente, todos pueden compartir el mismo cableado físico. Este concepto es conocido como "independencia de protocolos," lo que significa que dispositivos que son compatibles en las capas de los niveles físico y de datos permiten al usuario ejecutar muchos protocolosdiferentes sobre el mismo medio físico.

PROTOCOLO CSMA/CD

Definición de CSMA/CD

CSMA/CD son siglas que corresponden a las siglas Carrier Sense Multiple Access with Collision Detection, que corresponden a Acceso Múltiple por Detección de Portadora con Detección de Colisiones, es una técnica usada en las redes para mejorar las prestaciones. Antes de usar estas técnicas se usaron las de Aloha puro y Aloha ranurado, pero ambas tenían muy bajas prestaciones. Por esto, primero se creó el CSMA, luego se mejoró y surgió el CSMA/CD.

La meta de este protocolo es de evitar al máximo las colisiones. La diferencia principal con el protocolo de AlohaNet es que todos los equipos escuchan el medio y se detectan las colisiones.

A continuación se presenta un esquema del protocolo CSMA, que es muy parecido al de AlohaNet:

Funcionamiento

Su funcionamiento es:

1. Una estación que tiene un mensaje para enviar escucha al medio para ver si otra estación está transmitiendo un mensaje.

2. Si el medio esta tranquilo (ninguna otra estación esta transmitiendo), se envía la transmisión y se espera el ACK (acuse de recibo). La estación que recibe comprueba el CRC (detección de errores) y si es correcto envía el ACK. Si tras un tiempo no ha sido recibido el ACK, se pasa al paso 1. Si se recibe, la operación ha sido un éxito.

3. Cuando dos o más estaciones tienen mensajes para enviar, es posible que transmitan casi en el mismo instante, resultando en una colisión en la red.

4. Cuando se produce una colisión, todas las estaciones receptoras ignoran la transmisión confusa.

5. Si un dispositivo de transmisión detecta una colisión, envía una señal de expansión para notificar a todos los dispositivos conectados que ha ocurrido una colisión.

6. Las estaciones transmisoras detienen sus transmisiones tan pronto como detectan la colisión.

7. Cada una de las estaciones transmisoras espera un periodo de tiempo aleatorio e intenta transmitir otra vez.